История о том, почему кибербезопасность — это не только для больших корпораций

Есть такой распространённый миф среди владельцев небольших бизнесов: «Мы маленькие, кому мы вообще нужны? Хакеры идут за Газпромом и Сбербанком, а не за нашей бухгалтерией». Я понимаю эту логику. Она кажется разумной. Она даже звучит убедительно на планёрках. Только вот она в корне неверна — и я расскажу вам конкретную историю, после которой этот миф, надеюсь, умрёт навсегда.

Обычное утро, которое пошло не так

Представьте: маленькая компания, шесть человек, региональный городок. Торговля, склад, бухгалтерия — всё как у людей. Работают себе, никого не трогают. Есть сервер с 1С, есть удалённый программист, который этот сервер обслуживает. Классическая схема для малого бизнеса.

И вот однажды утром сотрудники приходят на работу, запускают 1С — и ничего. Программа не открывается. Заходят на сервер, смотрят на папку с базой данных — а там какая-то хрень непонятная. Файлы есть, но расширения чужие, незнакомые. И рядом лежит текстовый файл.

Открывают его — а там, значит, всё вежливо написано: ваши данные зашифрованы, для восстановления свяжитесь с нами вот по этому Telegram-аккаунту. Приятного аппетита.

Это был классический ransomware — программа-вымогатель. Вся база 1С, со всей историей заказов, клиентами, остатками на складе, взаиморасчётами — всё превратилось в набор нечитаемого мусора.

Бэкапов не было. Вообще. Ни одного.

Три дня переговоров

Директор — человек закалённый, не из робкого десятка — три дня вёл переговоры с мошенниками через Telegram. Торговался. Объяснял, что компания маленькая, что денег нет, что он вообще готов судиться. Те, в свою очередь, демонстрировали профессиональный подход: скидок не давали, на жалость не велись, но и цену особо не задирали. Бизнес, что поделать.

В итоге сошлись на двух тысячах долларов в биткоинах. Деньги перевели, ключ получили, базу расшифровали. Всё заработало.

Казалось бы — хеппи-энд? Ну, такой себе хеппи-энд, если честно.

Два штуки баксов — это ещё относительно дёшево. Некоторые платят десятки тысяч. Некоторые не получают ключ после оплаты. Некоторые получают рабочий ключ, но через месяц их шифруют снова — потому что дыра в безопасности никуда не делась.

Как это вообще произошло

Меня пригласили разобраться, что случилось. И знаете, это оказалось до обидного просто.

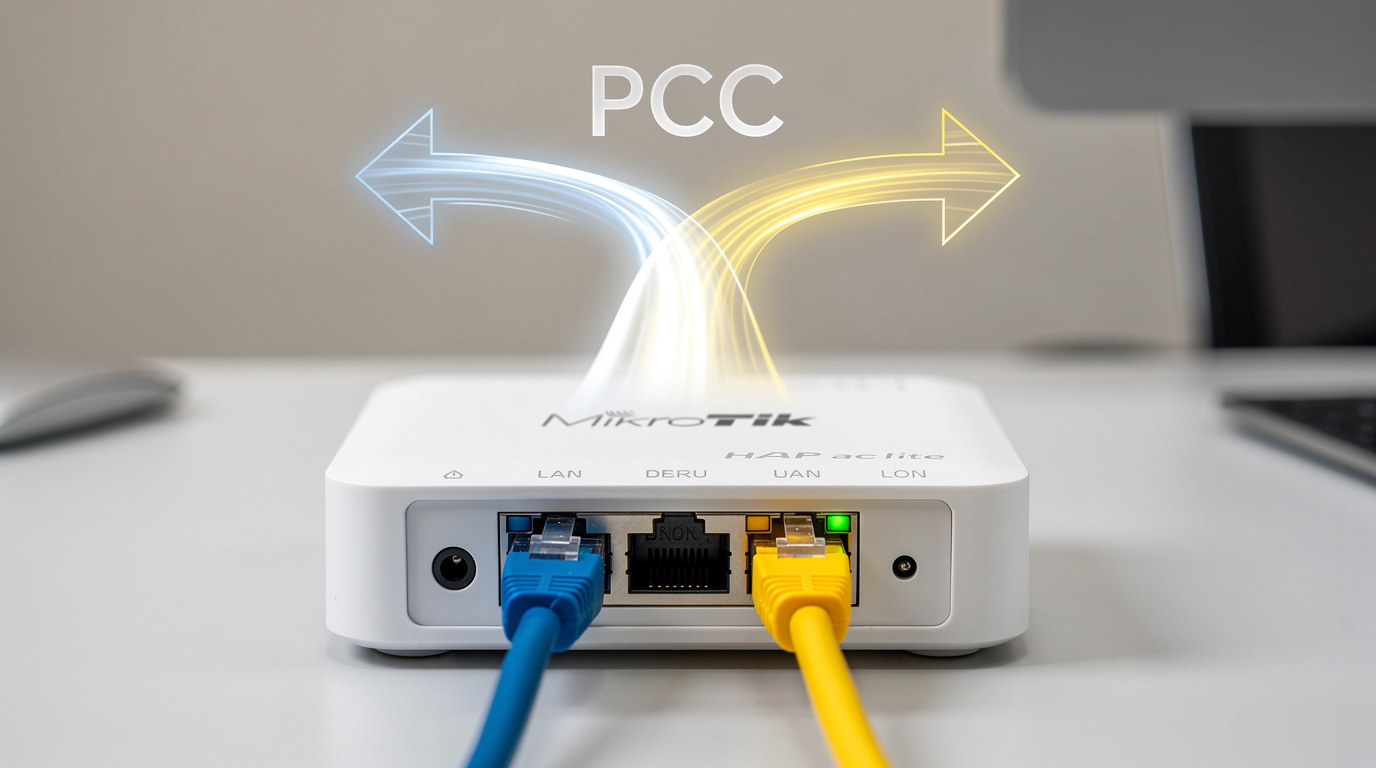

Удалённый программист 1С — нормальный, в общем-то, специалист по своей части — для удобства работы открыл наружу порт RDP. RDP — это Remote Desktop Protocol, то есть удалённый рабочий стол Windows. Штука удобная: подключаешься из дома, работаешь с сервером как будто сидишь рядом.

Только вот он этот порт повесил прямо в интернет. Без VPN, без дополнительной защиты, без ничего. И поставил пароль.

Пароль был что-то типа 12345678.

Вот и весь взлом. Никакой супер-хакерской атаки, никаких zero-day уязвимостей, никакой социальной инженерии. Просто боты в интернете постоянно сканируют все IP-адреса подряд, ищут открытые RDP-порты, и методично перебирают простые пароли. Это называется brute force, и это полностью автоматизировано. Никакой человек даже не смотрел на эту компанию специально — просто алгоритм нашёл открытую дверь с кодовым замком «1234» и зашёл.

Поздравляю, вы взломаны.

Что пришлось делать после

После того как пыль осела, пришлось перестраивать всё с нуля. По-хорошему, это надо было делать до инцидента — но что есть, то есть.

- Корпоративный VPN. Никакого RDP наружу. Хочешь подключиться к серверу — сначала подключись к VPN, и только потом иди куда надо. Это как охранник на входе: пропускает только своих.

- Файрволл с внятными правилами. Закрыть всё, что не нужно. Разрешить только то, что реально используется. Это звучит банально, но у большинства маленьких компаний файрволл либо отсутствует, либо настроен по принципу «разрешить всё входящее».

- Резервное копирование. Нормальное, регулярное, с проверкой, что бэкап вообще работает. Бэкап, который никто никогда не проверял — это не бэкап, это иллюзия безопасности. Правило 3-2-1: три копии данных, на двух разных носителях, одна из которых хранится отдельно.

- Обучение сотрудников. Люди кликают по фишинговым письмам, используют пароль «qwerty» на всём подряд, подключают чужие флешки. Не потому что они плохие — просто их никто никогда не учил, что это опасно.

Почему малый бизнес особенно уязвим

Вот в чём парадокс: маленькие компании думают, что они незаметны, а на самом деле они идеальная мишень.

У крупных корпораций есть выделенные специалисты по безопасности, корпоративные политики, сложная инфраструктура с несколькими уровнями защиты. Их сложно взломать. А малый бизнес — это открытый порт RDP с паролем «12345678». Это рай для автоматических атак.

Современный киберкриминал — это давно не романтичные хакеры в худи, которые целенаправленно охотятся за конкретной компанией. Это организованный бизнес с разделением труда: одни пишут зловредов, другие их распространяют, третьи ведут переговоры с жертвами, четвёртые отмывают биткоины. Им абсолютно всё равно, большая вы корпорация или ИП с шестью сотрудниками. Боты работают 24/7, сканируют весь интернет, и если у вас открытая дверь — они войдут.

Никто специально не выбирал эту компанию. Просто алгоритм нашёл уязвимость — и всё. Автоматически, безлично, равнодушно.

Что сделать прямо сейчас

Если вы читаете это и понимаете, что у вас «тоже примерно так» — вот короткий чеклист на сегодня:

- Закройте RDP наружу. Если удалённый доступ нужен — используйте VPN.

- Проверьте все пароли на серверах — если там что-то короче 12 символов без спецсимволов, меняйте немедленно.

- Настройте резервное копирование с автоматической проверкой.

- Убедитесь, что на всех компьютерах установлены актуальные обновления — особенно на серверах.

- Поговорите с сотрудниками о фишинговых письмах.

Это не rocket science. Это базовая гигиена, которая закрывает 80% реальных угроз для малого бизнеса.

Вместо заключения

Два часа работы нормального специалиста по безопасности — и этой истории с $2000 в биткоинах, тремя днями нервотрёпки и реальным риском потерять всю историю компании просто не было бы.

Информационная безопасность — это не про паранойю и не про бюджеты уровня «Роснефти». Это про элементарную ответственность перед своим бизнесом. Если вы застраховали машину и офис — застрахуйте и данные. Потому что данные сегодня стоят дороже любого имущества.

Современный киберкриминал не разбирает, большой вы или маленький, столичный или провинциальный. Ему важно одно: есть ли у вас открытая дверь. Не давайте ему этого шанса.

Берегите свои данные. И ставьте нормальные пароли, чёрт возьми.