Эмбеддинги простыми словами: как компьютеры учатся понимать смысл

Представьте огромную библиотеку, где миллионы книг, инструкций, писем и заметок лежат вперемешку. Вы спрашиваете: «Как вернуть товар?», а библиотекарь должен мгновенно найти нужный фрагмент — даже если в документе написано не «вернуть», а «процедура возврата продукции». Человек с этим справится: мы понимаем смысл, синонимы и контекст. Компьютер — нет. Для него текст сам по себе не “смысл”, а набор символов.

Чтобы машина могла работать со смыслом, используют идею: перевести слова, предложения, документы (а иногда и изображения или звук) в числа так, чтобы смысл при этом сохранялся. Такой перевод называется эмбеддинг (embedding).

Что такое эмбеддинг

Эмбеддинг — это вектор, то есть массив чисел, который представляет объект (слово, фразу, документ, товар, пользователя, картинку) так, чтобы похожие по смыслу объекты получались близкими по этим числам, а непохожие — далёкими.

Проще говоря:

- было: слово/фраза/документ (понятно человеку);

- стало: массив чисел (удобно компьютеру сравнивать).

Важно: эмбеддинг — не просто “кодировка”. Он старается уловить семантику (смысл) и связи между объектами.

Главная метафора: «карта смыслов»

Представьте огромную карту, где каждое слово (или документ) — как город. Слова с похожими значениями находятся рядом, слова с разными значениями — далеко.

Например, «король», «королева», «монарх» окажутся в одном регионе. «Яблоко» и «апельсин» — в другом, тоже рядом. А «король» и «яблоко» будут далеко друг от друга.

Эмбеддинг — это как GPS-координаты каждого “города” на этой карте. Когда у компьютера есть координаты, он может сравнивать смыслы: что ближе, что дальше, что похоже, что относится к одной теме.

Почему вообще нужно переводить смысл в числа

Компьютер в основе работает с числами. Да, текст и так хранится как числа (коды символов), но такие числа не передают смысл. Если просто присвоить словам номера — «кот = 17», «собака = 18», «самолёт = 19» — из этого не видно, что кот ближе к собаке, чем к самолёту.

Эмбеддинги создают числа так, чтобы смысловая близость превращалась в числовую близость.

Чем эмбеддинги отличаются от старых способов “превращать текст в числа”

Существуют классические подходы вроде Bag of Words (“мешок слов”) и TF-IDF. Они считают, какие слова встречаются в тексте и с каким весом. Это полезно, но у метода есть типичные проблемы:

- вектор получается очень длинным (по размеру словаря — тысячи или десятки тысяч измерений);

- в нём много нулей — такое представление называют разреженным (sparse);

- оно слабо понимает смысл и синонимы: «возврат» и «аннулирование покупки» могут выглядеть как разные темы.

Эмбеддинги обычно делают иначе: векторы получаются плотными (dense) — в них большинство чисел не нули, а длина вектора намного меньше (например, 256, 768, 1024, 1536 измерений). При этом такие векторы лучше отражают смысл и связи.

Как эмбеддинги “учатся” смыслу

Эмбеддинги чаще всего не задают вручную. Их обучают на больших данных.

Есть простая идея (её часто формулируют так): слова, которые встречаются в похожих контекстах, имеют похожие значения. Если модель много раз видит, что «кот», «кошка», «пёс», «собака» встречаются рядом со словами «корм», «миска», «дом», «спит», то она начинает располагать их ближе друг к другу на “карте смыслов”.

Если описывать процесс на пальцах:

- сначала каждому слову дают случайные координаты (как будто города раскидали на карте случайно);

- модель пытается предсказывать окружение слова или слово по окружению;

- если ошиблась — слегка “подправляет” координаты;

- после миллионов шагов карта становится осмысленной: похожие слова и фразы группируются.

Статические и контекстные эмбеддинги

Есть два больших подхода к эмбеддингам текста.

Статические эмбеддинги (например, Word2Vec и GloVe): каждому слову соответствует один и тот же вектор, который не меняется. Минус: многозначные слова становятся проблемой. Слово «коса» в смысле «причёска» и «инструмент» получает один и тот же вектор.

Контекстные эмбеддинги (например, модели семейства BERT и GPT): вектор слова зависит от контекста. «Коса» в предложении про волосы будет ближе к словам про причёски, а в предложении про инструмент — ближе к словам про сельхозинструменты. Это гораздо ближе к тому, как понимает язык человек.

Что значит “вектор” и почему по нему можно сравнивать смысл

Вектор — это просто список чисел. Если вектор двумерный, он выглядит как [x, y] и это точка на плоскости. Если трёхмерный — [x, y, z]. Эмбеддинги обычно имеют сотни измерений, и представить их глазами трудно, но компьютер отлично умеет работать с такими объектами.

Главное, что с векторами можно делать полезную операцию: измерять близость.

Если два текста похожи по смыслу, их векторы будут близки. Если смысл разный — далеко. Для измерения близости используют разные метрики. На практике часто применяют косинусную близость, которая сравнивает “направление” векторов и хорошо подходит для смыслового сравнения.

Арифметика смыслов: почему иногда получается «король − мужчина + женщина ≈ королева»

Иногда эмбеддинги показывают красивый эффект: можно “сдвинуться” в пространстве смыслов. Пример: «король» отличается от «королевы» примерно так же, как «мужчина» отличается от «женщины». Если вычесть “мужское” и добавить “женское”, можно оказаться рядом с «королевой».

Это не магия и не обещание, что так будет всегда, но хороший пример того, что эмбеддинги умеют отражать отношения.

Где эмбеддинги применяются в реальной жизни

Семантический поиск (поиск “по смыслу”)

Вы пишете: «как вернуть товар», а документ называется «процедура возврата продукции». Поиск по ключевым словам может промахнуться, а поиск по эмбеддингам найдёт, потому что смысл рядом.

Рекомендательные системы

Эмбеддинги можно строить не только для текста, но и для товаров и пользователей. Если вектор пользователя близок к вектору товара — вероятно, это то, что ему подойдёт. Так работают рекомендации в маркетплейсах и сервисах контента.

Классификация текстов

Антиспам, сортировка обращений в поддержку, определение тональности — всё это часто строится так: текст превращают в эмбеддинг, а затем модель решает, к какому классу это ближе (спам/не спам, жалоба/вопрос/предложение и т.д.).

Чат-боты и ответы по базе знаний

Когда компания делает “умного” помощника по своим документам, эмбеддинги становятся основой: вопрос пользователя превращается в вектор, а дальше система ищет самые близкие по смыслу фрагменты из базы знаний.

Эмбеддинги и RAG: как чат-бот отвечает по вашим документам

Один из самых популярных подходов сейчас — RAG (Retrieval-Augmented Generation, “генерация с подкреплением поиском”). Он нужен, чтобы бот отвечал не “из головы”, а опирался на ваши документы.

Схема выглядит так:

- пользователь задаёт вопрос;

- вопрос превращается в эмбеддинг;

- система ищет в базе знаний фрагменты текста, которые ближе всего по смыслу;

- несколько лучших фрагментов добавляются в контекст;

- языковая модель формирует ответ, используя найденные источники.

Именно эмбеддинги в этом процессе играют роль “компаса”, который помогает быстро найти нужные куски информации.

Где хранят эмбеддинги: векторные базы данных

Когда документов много (тысячи, миллионы), для каждого есть вектор. Нужно быстро находить “самые близкие” векторы. Для этого используют векторные базы данных — специальные хранилища, оптимизированные под поиск ближайших соседей.

Если говорить совсем просто: это “база”, которая умеет отвечать на вопрос: «какие 10 фрагментов текста ближе всего по смыслу к моему запросу?»

Эмбеддинги бывают не только для текста

Хотя чаще всего о них говорят в контексте языка, эмбеддинги можно получать из разных типов данных:

- изображения — чтобы искать похожие картинки, распознавать объекты, группировать фото;

- аудио — чтобы сравнивать записи, искать похожие фрагменты, анализировать голос;

- мультимодальные объекты (текст + картинка, картинка + звук) — чтобы учитывать смысл “целиком”.

Почему эмбеддинги важны для “памяти” AI-систем

Когда говорят про “AI-агентов” и “память”, часто речь идёт о том, что система должна уметь:

- вспоминать похожие случаи;

- находить важные факты о клиенте, проекте, теме;

- доставать нужные инструкции из базы знаний.

Технически это очень часто делается через эмбеддинги: “вспомнить” означает найти по смыслу похожие записи в памяти, а “похожесть” измеряется близостью векторов.

Ограничения: чего эмбеддинги не обещают

Чтобы ожидания были реалистичными, важно понимать границы технологии.

- Эмбеддинги не дают истину. Они дают “похожесть по смыслу”, это вероятностный механизм.

- Они могут ошибаться на коротких или двусмысленных запросах.

- Качество зависит от данных. Если документы извлечены плохо (например, PDF превратился в “кашу”), то и поиск будет хуже.

- Эмбеддинги не заменяют логику. Они помогают найти нужное, но не являются “разумом”.

Поэтому в серьёзных системах эмбеддинги дополняют фильтрами, проверками, “переранжированием” результатов и другими инженерными приёмами.

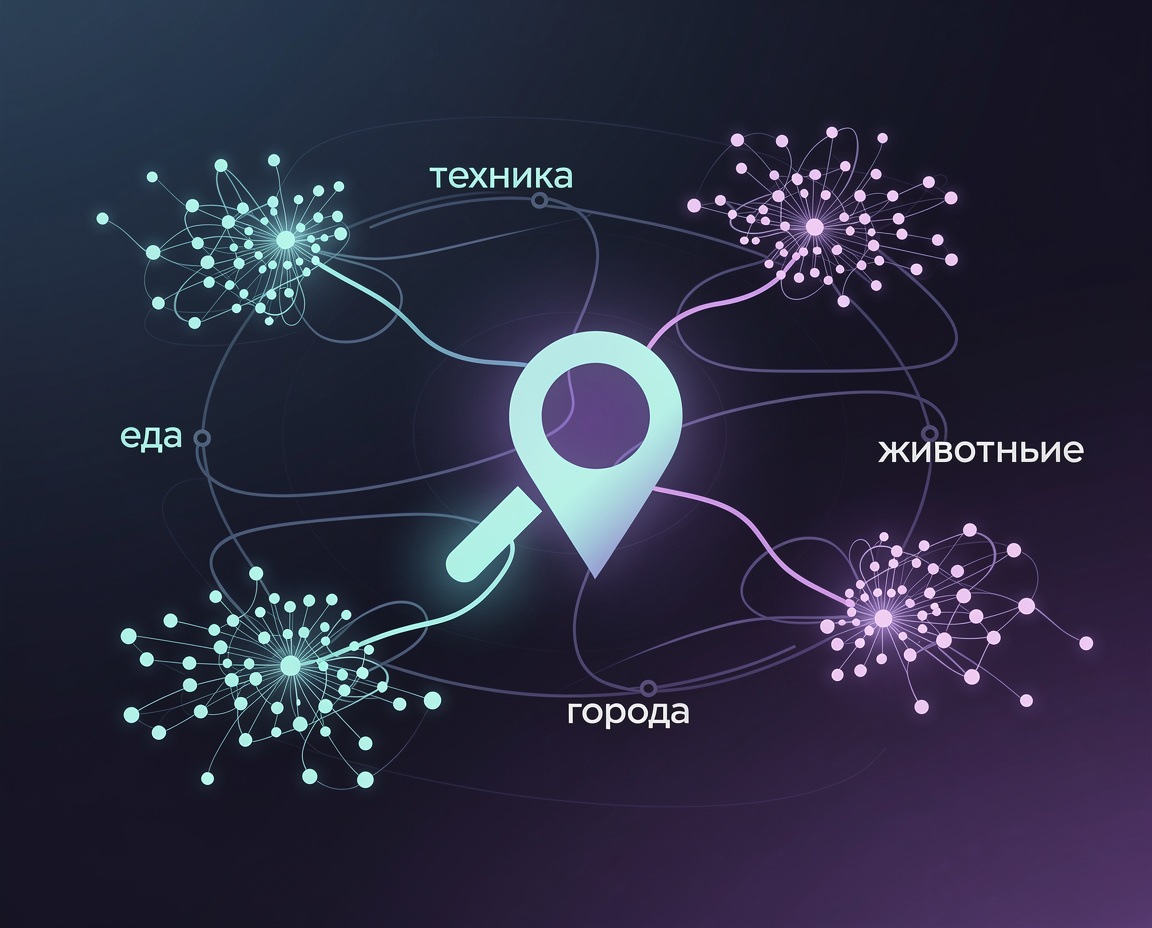

Как визуально представить эмбеддинги, если у них сотни измерений

Человеческому мозгу сложно представить пространство на 300 или 1000 измерений. Поэтому для демонстраций используют методы “сжатия” размерности (например, PCA или t-SNE). Они переводят многомерные точки на плоскость, стараясь сохранить относительные расстояния.

Если визуализировать эмбеддинги, обычно видно:

- кластеры: слова и тексты на близкие темы группируются;

- структуру: “страны” отдельно, “животные” отдельно, “еда” отдельно;

- направления: отношения вроде “страна → столица” часто похожи для разных пар.

Короткое резюме

Эмбеддинг — это способ представить смысл объекта (слова, текста, документа, товара, картинки) в виде массива чисел так, чтобы похожее по смыслу оказалось близко. Благодаря этому компьютеры могут искать, сравнивать и группировать информацию не только по совпадению слов, но и по смыслу. Именно эмбеддинги лежат в основе семантического поиска, рекомендаций, RAG-чатботов и “памяти” современных AI-систем.

Мини-словарик

- Вектор — список чисел (координаты объекта в многомерном пространстве).

- Размерность — сколько чисел в векторе.

- Семантика — смысл.

- Контекст — окружение слова/фразы, влияющее на значение.

- Векторная база — хранилище эмбеддингов с быстрым поиском ближайших по смыслу.

- RAG — подход “нашёл релевантные фрагменты → добавил в контекст → сгенерировал ответ”.